¿Recuerdan la inolvidable actuación de Madonna en Eurovisión 2019 en Tel Aviv? Esta fue financiada por el filántropo Sylvan Adams con una suma estimada $1,3 millones ¿Qué fue lo que se convirtió instantáneamente en uno de los momentos más controvertidos en la historia del programa? Contrario a las expectativas que se tenían de un ícono del pop impecable, su interpretación en vivo de "Like a Prayer" sufrió de inestabilidad audible en el tono, problemas de entonación notables e imprecisiones vocales que incluso los oyentes ocasionales pudieron detectar, lo que generó un amplio debate en las redes sociales y los foros de música. Muchos críticos no se centraron en su mensaje artístico, sino que plantearon una pregunta directa: ¿Acaso Madonna, una de las vocalistas más exitosas de la historia, ya no es capaz de cantar en vivo al nivel que se espera de ella?

Tras el evento, circularon por internet innumerables versiones de la actuación, tanto grabadas por fans como editadas en estudio, donde las voces sonaban estables y mucho más pulidas, resultado del procesamiento digital y de herramientas de corrección de tono como Auto-Tune o tecnologías similares. Si bien ninguna declaración oficial confirmó el uso de corrección de tono durante la actuación en directo, el contraste entre el sonido pulido en estudio y la interpretación sin editar puso de manifiesto la enorme diferencia que puede generar el procesamiento vocal moderno.

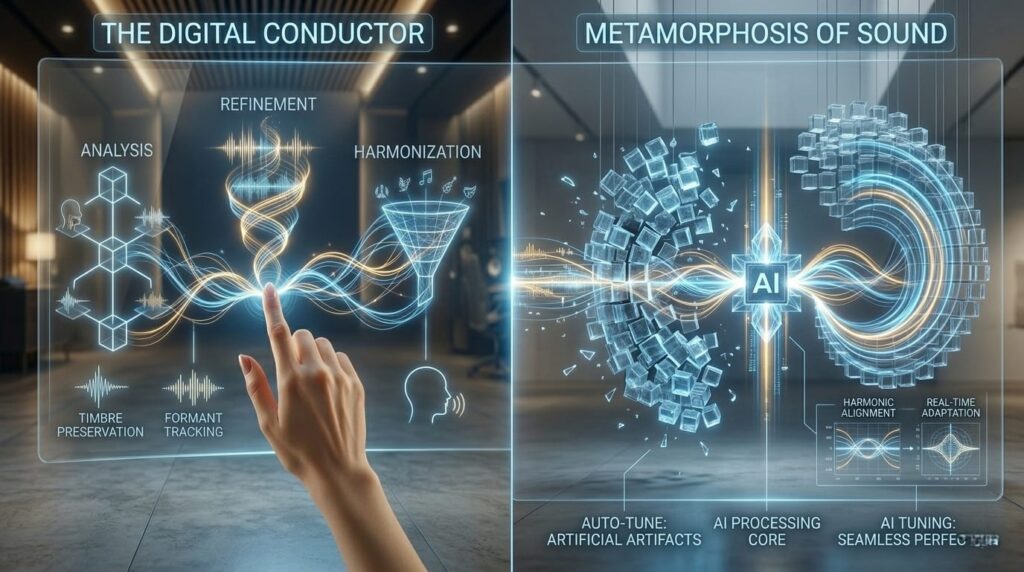

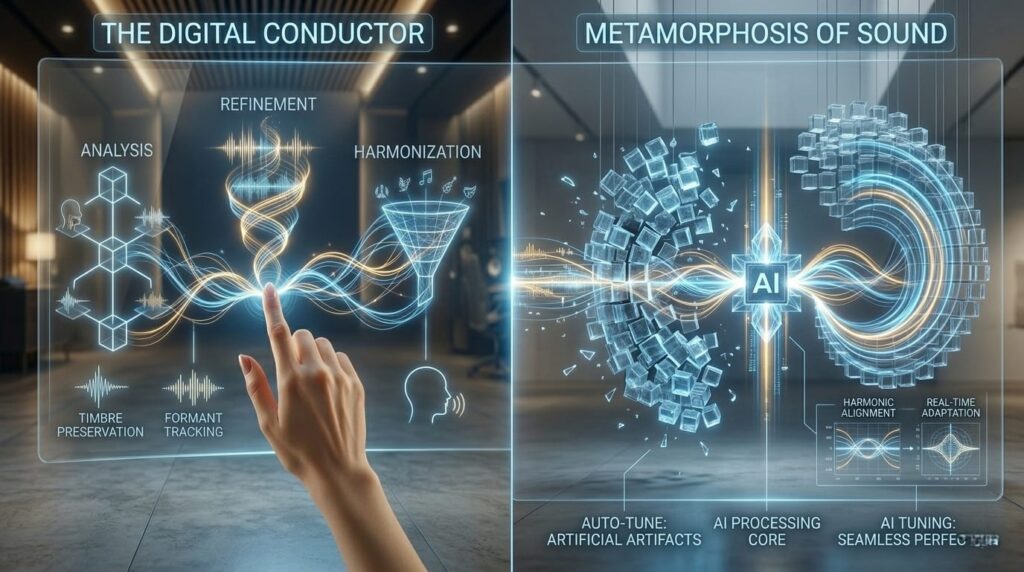

Aquí tienes una herramienta comparativa de rendimiento que puedes ver y que ilustra la diferencia en la calidad vocal después de la afinación:

El caso de Madonna se ha convertido casi en un hecho académico: una ilustración real de cómo las tecnologías de corrección vocal no solo pueden mejorar una interpretación, sino también crear la ilusión de una capacidad vocal que puede no existir en la realidad.

Aquí es precisamente donde comienza el debate más amplio sobre la corrección vocal basada en IA: difuminar la línea entre una voz tal como existe de forma natural y una voz que ha sido remodelada, corregida y diseñada para los estándares de escucha modernos.

¿Qué es Auto-Tune? Breve historia e impacto.

Auto-Tune Es un software de corrección de tono desarrollado originalmente en 1997 por Antares Audio Technologies y el ingeniero Andy Hildebrand. Diseñado para medir y corregir discretamente el tono de las pistas vocales, permitía que las grabaciones sonaran perfectamente afinadas sin necesidad de edición manual.

Inicialmente concebido como una herramienta de producción discreta para corregir notas desafinadas y realzar la expresión musical, Auto-Tune evolucionó rápidamente hasta convertirse en un recurso creativo y estilístico. El éxito de Cher de 1998, Believe, fue el primer ejemplo destacado donde el efecto se llevó al extremo, produciendo una distintiva textura vocal robótica o futurista, un sonido que más tarde se conoció como el efecto Cher e inspiró a innumerables artistas de diversos géneros.

Si bien Auto-Tune se concibió originalmente para ayudar a que las voces se mantuvieran afinadas, también se convirtió en un sonido característico, adoptado por artistas de pop, hip-hop, R&B y música electrónica. Artistas como T-Pain hicieron de este efecto un elemento central de su identidad musical. Incluso hoy en día, muchos productores e intérpretes utilizan Auto-Tune no solo para corregir, sino también para crear experiencias sonoras únicas.

Auto-Tune vs. IA: La evolución de la corrección vocal

Con el tiempo, Auto-Tune se ha extendido a muchos géneros: desde el rock y el pop hasta el R&B y el hip-hop, incluyendo canciones de Lil Wayne, Black Eyed Peas y Kanye West. Pero también ha generado debate. Los críticos argumentan que el uso excesivo de la corrección de tono puede enmascarar imperfecciones, eliminando matices y expresividad de una interpretación. El rapero Jay-Z creó la canción DOA – Death Of Auto-Tune como una declaración en contra del uso excesivo de esta tecnología. Algunos lo ven como una prótesis digital en lugar de una mejora, un "filtro de Photoshop para la música" que suaviza las imperfecciones a costa de la individualidad.

Quienes lo defienden afirman que no es intrínsecamente malo, sino simplemente una herramienta más en el arsenal del productor. Sin embargo, la percepción del arte sí cambia cuando las interpretaciones se perfeccionan más allá de la capacidad humana natural.

Herramientas de IA

Actualmente, las herramientas modernas basadas en inteligencia artificial han llevado la afinación vocal mucho más allá de lo que logró originalmente Auto-Tune. Estos sistemas de IA no se limitan a corregir las notas desafinadas al semitono más cercano; interpretan el contexto melódico, los matices vocales, la expresión emocional y las características vocales naturales, lo que les permite corregir el tono de una manera que preserva la variación expresiva, no solo la precisión mecánica.

Por ejemplo, Audimee AI vocal, Se trata de una herramienta de corrección de tono vocal basada en IA que analiza las grabaciones en detalle, identificando no solo los errores de tono, sino también características estilísticas, como el vibrato y el fraseo, para ofrecer resultados que suenan más orgánicos y expresivos.

Los investigadores también están desarrollando marcos como BERT-APC, Estos sistemas buscan corregir la afinación sin depender de notas de referencia predefinidas, preservando la intención emocional y expresiva a la vez que afinan de forma más natural. A diferencia de los sistemas de corrección más antiguos, estos modelos infieren el contexto musical y conservan la desviación expresiva, lo que supone un gran avance para mantener el elemento humano en la interpretación.

Auto-Tune en actuaciones en directo: antes y ahora.

Al principio, Auto-Tune era principalmente una herramienta de estudio. Los productores la aplicaban sutilmente después de la grabación. Pero con los años, incluso han surgido tecnologías para actuaciones en directo. Herramientas como Antares Auto-Tune en directo y Waves Sintoniza en tiempo real Permite a los vocalistas escuchar las voces corregidas en tiempo real durante las actuaciones en directo, con una latencia extremadamente baja, de modo que el intérprete percibe el sonido corregido de inmediato.

Estas herramientas Conéctate a sistemas de sonido en vivo y analizar voces en la flautay, ofreciendo a los intérpretes la confianza para ofrecer voces en vivo con corrección de tono frente al público. Esto es una salto dramático Desde aquellos tiempos en que la afinación solo se realizaba en estudios.

Corrección vocal mediante IA: El futuro de la expresión musical

Hoy en día, a medida que la IA evoluciona, la distinción entre corrección y creación se vuelve más difusa. La IA no solo corrige el tono, sino que también puede preservar los matices expresivos, interpretar el contexto y generar actuaciones que se sientan menos como edición digital y más como colaboración artística. La investigación moderna y los modelos de IA son explícitamente construido para mantener la naturalidad y lógica emocional, no solo precisión en el tono.

Este movimiento De la corrección mecánica a la interpretación contextual Puede que por eso las herramientas basadas en IA sean cada vez más las preferidas para producir voces que sigan sonando humanas, incluso cuando se aplica afinación.

¿Es esta una evolución buena o mala?

El debate continúa. Algunos ven la corrección de voz mediante IA como una forma de democratizar la producción musical, permitiendo que creadores de todos los niveles logren interpretaciones de calidad profesional. Otros temen que la dependencia de las herramientas de posproducción desincentive la formación vocal y reduzca la presencia de la expresión humana genuina e imperfecta en la música.

Una cosa está clara: La era del procesamiento estricto solo de tono, el mundo del Auto-Tune, se ha expandido a algo mucho más amplio.. Las herramientas actuales pueden interpretar, mejorar e incluso generar interpretaciones vocales utilizando modelos de IA complejos que tienen en cuenta la expresión emocional y la intención artística.

Conclusión: Equilibrando la tecnología con el arte.

Auto-Tune revolucionó la música al ofrecer una solución sencilla para corregir el tono e inspirar nuevos efectos artísticos que influyeron en géneros de todo el mundo. Ahora, las tecnologías vocales basadas en IA llevan ese legado aún más lejos, ofreciendo una afinación y transformación vocal sensible al contexto y a las emociones, que preserva las cualidades expresivas en lugar de simplemente alinear el tono.

La verdadera pregunta para los artistas y productores hoy en día no es si deben usar Auto-Tune o IA. Es cómo equilibrar las tecnologías con la expresión artística auténtica. Gracias a las herramientas de inteligencia artificial para la voz que mejoran sin borrar los matices humanos, el futuro de la música puede que no consista en reemplazar el talento, sino en amplificarlo de formas nuevas y significativas.